ΩλΛΟΛ―ΛιΛΟΛΤΛΛΛΤΓΔΒ≠ΜωΛρΒ·Λ≥ΛΙΛ≥Λ»Λ§Ϋ–ΆηΛ ΛΛΛΈΛ«ΓΔΦΧΩΩΛάΛ±ΓΔΦηΛξΒόΛ°UPΛΖΛΩΛΣΓΣ

Γζ ά–ΦμΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛ«≈ΏΛρ±έΛΖΛΤ:

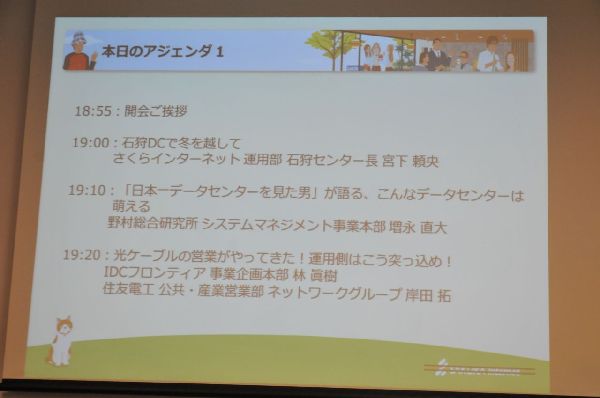

ά–ΦμΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛ«≈ΏΛρ±έΛΖΛΤ / ΛΒΛ·ΛιΞΛΞσΞΩΓΦΞΆΞΟΞ»≥τΦΑ≤ώΦ“ ±ΩΆ―…τ ά–ΦμΞΜΞσΞΩΓΦΡΙ Βή≤ΦΜα

ΦΪΗ Ψ“≤πΓΘ

38Κ–Λ«≤Θ…ΆΫ–Ω»ΓΘ

2005«·11ΖνΤΰΦ“ΓΘΕλΦξΛ ΣΛœΓΔ¥®ΛΒΓΘ¥®Λ§ΛξΛ ΛΈΛ«ΓΔΚΘΛ«ΛβΞΜΓΦΞΩΓΦΛρΟεΛΤΛΛΛόΛΙΓΘ

ΛΫΛσΛ ΩΆ¥÷Λ§ΥΧ≥ΛΤΜΛΥΙ‘ΛΟΛΩΓΘ

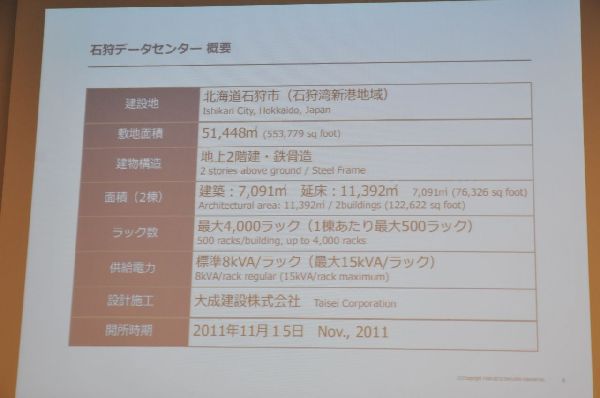

ά–ΦμΞΜΞσΞΩΓΦ≥ΒΆΉ

ΥΧ≥ΛΤΜά–ΦμΜ‘ΛΥΖζάΏΓΘ≈ΎΟœΧΧά―Λœ≈λΒΰΞ…ΓΦΞύΛ»ΛέΛήΤ±ΛΗ51,448m^2

ΗΫΚΏ2≈οΛόΛ«ΛΖΛΪΛΩΛΟΛΤΛΛΛ ΛΛΛ§ΓΔΚ«¬γ8≈οΓΘ4000ΞιΞΟΞ·ΛΈΒ§ΧœΓΘ

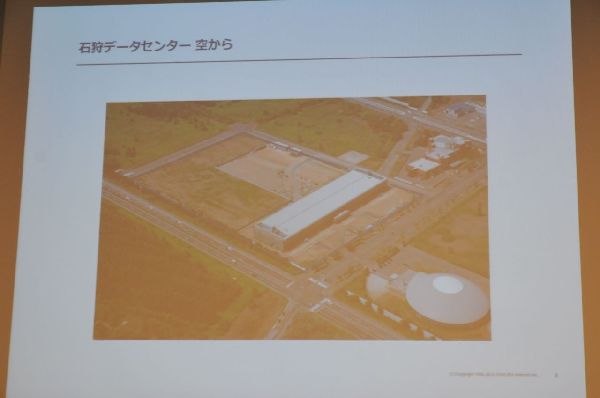

ά–ΦμΞ«ΓΦΞΩΞΜΞσΞΩΓΦ ΨεΕθΛΪΛι

ά–ΦμΞ«ΓΦΞΩΞΜΞσΞΩΓΦΨ≠ΆηΝϋ

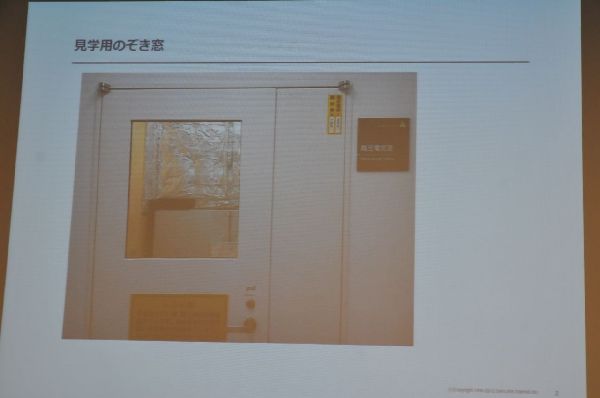

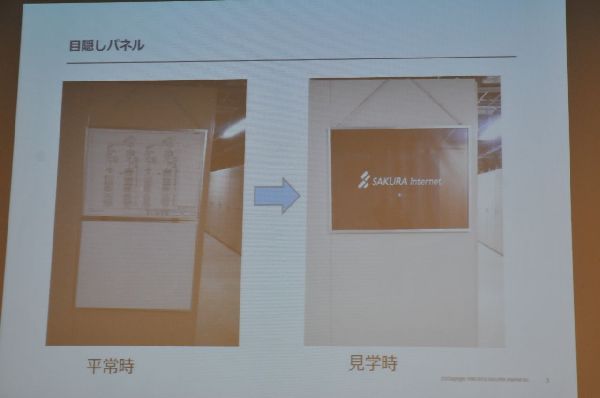

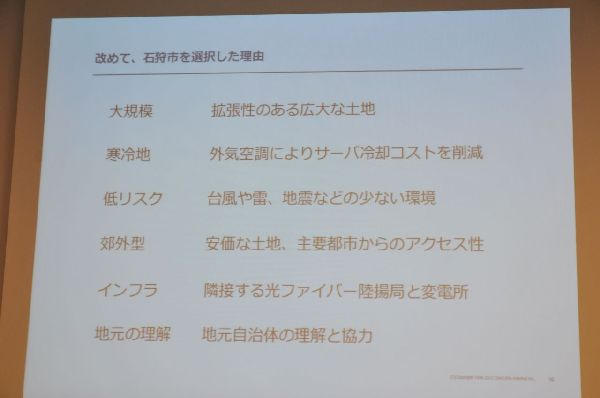

ά–ΦμΜ‘ΛρΝΣ¬ρΛΖΛΩΆΐΆ≥

≥»ΡΞά≠ΛΈΛΔΛκΙ≠¬γΛ ≈ΎΟœΓΔ¥®ΈδΟœΓΔ¥®ΛΛΓΘ≥Α…τΕθΡ¥ΛΥΛηΛΟΛΤΓΔΞΒΓΦΞ–ΛΈΈδΒ―Ξ≥ΞΙΞ»ΛρΚοΗΚΫ–ΆηΛκΓΘ

ΡψΚ“≥≤ΓΘ¬φ…ςΛδΆκΓΔΦΪΩ»Λ Λ…Ψ·Λ ΛΛΓΘΙΌ≥ΑΛ ΛΈΛ«ΓΔ≈ΎΟœΛ§Α¬ΛΛΓΘ

ΜΞΥΎΛΥΕαΛΛΛΈΛ«ΓΔ»σΨοΛΥΞΔΞ·ΞΜΞΙΛ§Έ…ΛΛΓΘ≈λΒΰΓΝάιΚ–ΛόΛ«ΑλΤϋ50ΥήΛ»¬ΩΛ·ΞΔΞ·ΞΜΞΙΛ§Έ…ΛΛΓΘ

ΞΛΞσΞ’ΞιΛΥ¥ΊΛΖΛΤΛœΓΔΈΌάήΛΙΛκΗςΞ’ΞΓΞΛΞ–ΓΦΈΠΆ»Λ≤Ε…ΓΔ ―≈≈ΫξΛœ300mΛΑΛιΛΛΛ ΛΈΛ«ΓΔ…ιΟ¥ΕβΛβΑ¬ΛΛΓΘ

ΟœΗΒΛΈ ΐΛΈΆΐ≤ρΛ§ΛΔΛκΓΘ

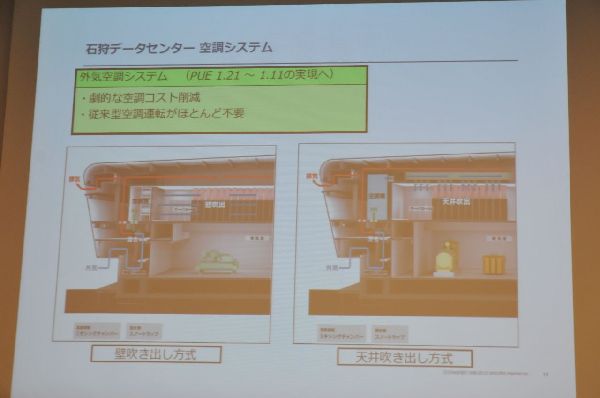

ά–ΦμΞ«ΓΦΞΩΞΜΞσΞΩΓΦ ΕθΡ¥ΞΖΞΙΞΤΞύ

≥Α…τΕθΡ¥Λ«ΓΔPUE1.1 ΓΝ 1.2ΛρΧήΜΊΛΙΓΘ

ΛΫΛΈΛόΛόΩαΛΛΛΩΛξΛΙΛκΛ»ΓΔΈδΛ®ΛΤΛΖΛόΛΠΛΈΛ«ΓΔ«―«°ΛρΚ°ΛΦΛΤΩαΛ≠Ϋ–ΛΙ ΐΦΑΛΥΛ ΛΟΛΤΛΛΛκΓΘ

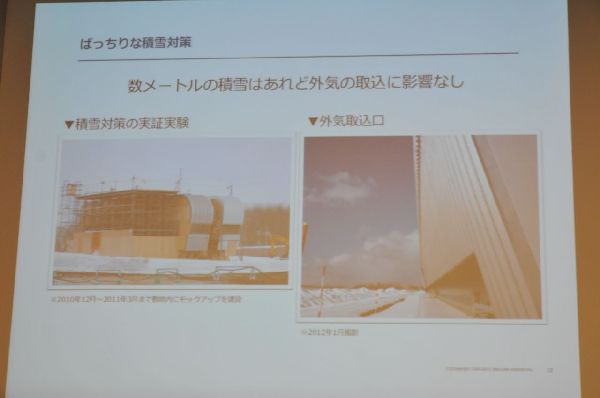

ά―άψ¬–Κω

ΖζάΏΜΰΛΥΞβΞΟΞ·ΞΔΞΟΞΉΛρΚνΛΟΛΤΓΔά―άψΛΈΜνΗ≥ΛρΛΖΛΤΛΛΛκΓΘ

≥ΑΒΛΛρΦηΛξΤΰΛλΗΐΛ§Λ≥ΛΈΛηΛΠΛ ΙΫ¬ΛΛρΛΖΛΤΛΛΛΤΓΔάψΛ§ΛΩΛόΛΟΛΤ≥ΑΒΛΛ§ΤΰΛιΛ ΛΛΛηΛΠΛ ΜωΛ§Λ ΛΛΛηΛΠΛΥΙ©…ΉΛΖΛΤΛΛΛκΓΘ

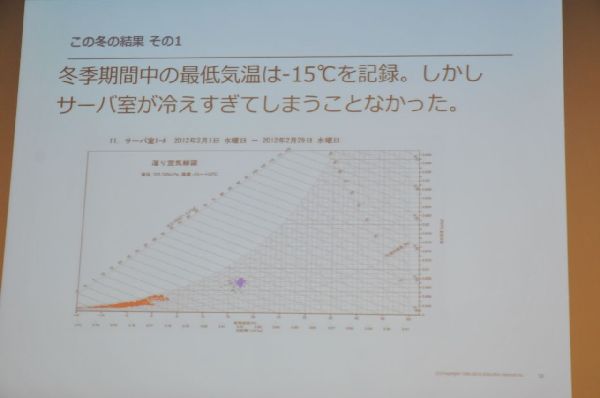

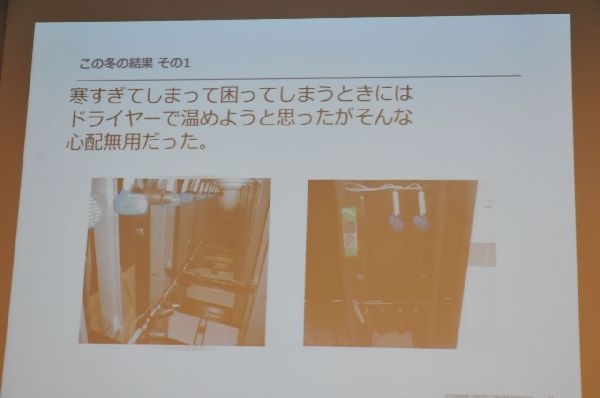

Λ≥ΛΈ≈ΏΛΈΖκ≤Χ ΛΫΛΈ1

≈Ώ¥ϋ¥ϋ¥÷ΟφΛΈΚ«ΡψΒΛ≤ΙΛœ-15ΓνΛρΒ≠œΩΓΘΛΖΛΪΛΖΓΔΞΒΓΦΞ–ΦΦΛ§ΈδΛ®ΛΙΛ°ΛΤΚΛΛκΛ≥Λ»ΛœΧΒΛΪΛΟΛΩΓΘ

ά÷ΛΈΞΉΞμΞΟΞ»Λ§≥ΑΒΛΓΔάΡΛΈΞΉΞμΞΟΞ»Λ§ΞΒΓΦΞ–ΦΦΛΈΒέΒΛΓΘ¬ΩΨ·Λ÷ΛλΛΤΛΛΛκΛ§Χδ¬ξΛΈΧΒΛΛ≤Ι≈ΌΓΘ

ΈδΛ®ΛΙΛ°ΛΤΚΛΛκΛ»Λ≠ΛΈΑΌΛΥΓΔΟ»ΛαΛκάΏ»ςΛ§ΧΒΛΛΛΈΛ«ΓΔΞ…ΞιΞΛΞδΓΦΛρ ίΗ±Λ«Ά―Α’ΛΖΛΩΛ§ΓΔΩ¥«έΧΒΆ―ΛάΛΟΛΩΓΘ

≈ΏΛρ±έΛΖΛΤΓΔΛΛΛμΛΛΛμΛ»Χδ¬ξΛ§Β·Λ≠ΛΩΓΘ

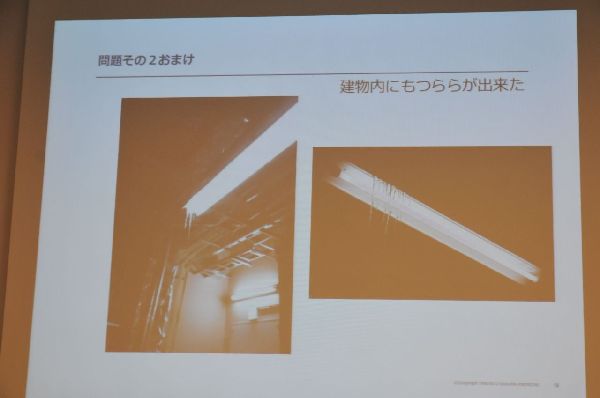

Χδ¬ξΛΫΛΈΘ±

ΞΒΓΦΞ–Λ»ΛΖΛΤΛœΝ¥Ν≥Χδ¬ξΛ ΛΪΛΟΛΩΛ§ΓΔ¬ΨΛ«ΛΛΛμΛΛΛμΛ»Β·Λ≥ΛΟΛΩΓΘ

ΗΫΨλΛœ¬γ ―ΛάΛΟΛΩΓΘ»σΨοΛΥάψΩΦΛΛΓΘά–ΦμΛœΛΫΛσΛ ΛΥάψΛœΙΏΛιΛ ΛΛΛ» ΙΛΛΛΤΛΛΛΩΛ§ΓΔΛΫΛσΛ Λ≥Λ»ΛβΛ Λ·ΓΔΛάΛόΛΒΛλΛΩΛ»ΜΉΛΟΛΩΓΘ

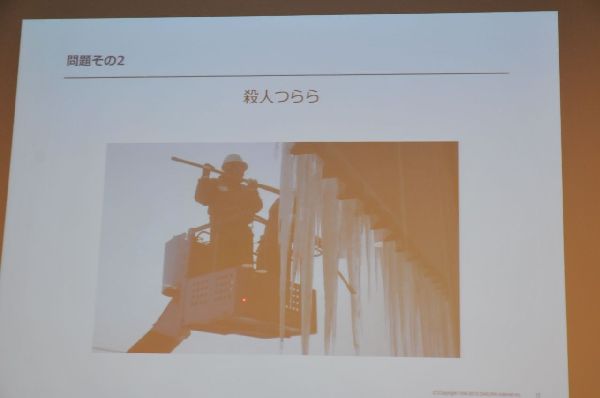

Χδ¬ξΛΫΛΈΘ≤ ΜΠΩΆΛΡΛιΛι

ΛΫΛΈΛέΛΪΛΈΧδ¬ξΛ»ΛΖΛΤΓΔΜΠΩΆΛΡΛιΛιΓΘΛΡΛιΛιΛ§Λ“Λ…ΛΛΓΘ

ΙβΫξΚνΕ»Φ÷ΛρΛΡΛΪΛΟΛΤΓΔΛΡΛιΛιΛρΆνΛ»ΛΙΓΘ

Υη«·Ρξ¥ϋ≈ΣΛΥΛδΛιΛ ΛΛΛ»ΛΛΛ±Λ ΛΛΛ≥Λ»Λ§Μ≥ά―ΛΏΓΘ

ΛΣΛόΛ±Λ»ΛΖΛΤΓΔΖζ ΣΛΈΟφΛΥΛβΛΡΛιΛιΛ§Λ«Λ≠ΛΤΛΖΛόΛΟΛΩΓΘ»σΨοΛΥ¥®ΛΪΛΟΛΩΓΘ

Χδ¬ξΘ≥ ΖκœΣ

ΞΒΓΦΞ–ΦΦΛΥΛΫΛΈΛόΛόΛβΛΝΛ≥ΛύΛ»ΓΔΖκœΣΛΙΛκΛΈΛ«ΓΔΛΫΛΈΛόΛόΛ«ΛœΜ»Λ®Λ ΛΛΛΈΛ«ΓΔΞΒΓΦΞ–ΞκΓΦΞύΛ»Τ±ΛΗΦΨ≈ΌΛΈΛ»Λ≥ΛμΛ«ΓΔ8Μΰ¥÷ΛΑΛιΛΛΛΣΛΛΛΤΞΒΓΦΞ–ΛράΏΟ÷ΓΘ

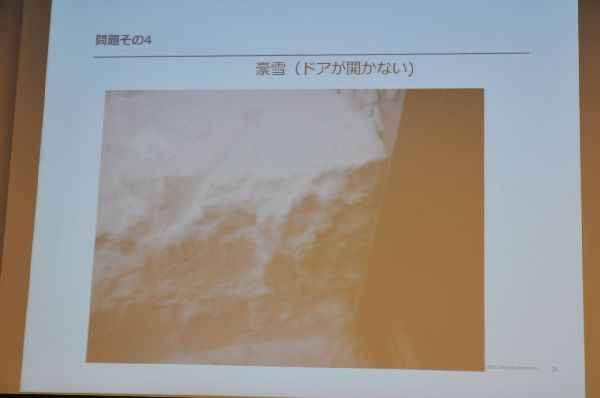

Χδ¬ξΘ¥ Ικάψ(Ξ…ΞΔΛ§≥ΪΛΪΛ ΛΛ)

ΈδΒ―≈οΛ§ΧάΛΛΛΤΛΛΛκ≥ΑΛΈ»βΛ§ΓΔΫ–ΛηΛΠΛ»ΛΖΛΤΛβΓΔΫ–ΛλΛ ΛΛΓΘ

Τ–ΛΒΛσΛρΗΤΛσΛ«ΓΔΡΙΛœΛΖΛ¥Λ«ΤΰΛΟΛΤΛβΛιΛΟΛΩΓΘ

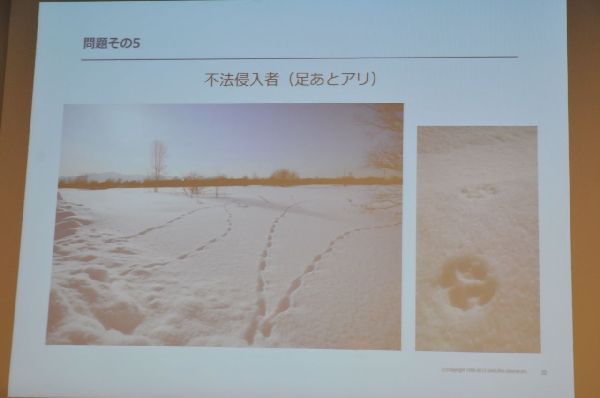

Χδ¬ξΘΒ …‘ΥΓΩ·Τΰ

ΖκΙΫΤΑ ΣΛ§ΛΛΛκΓΘΗΛΛΪΛ Λ»ΛΣΛβΛΟΛΩΛιΗ―ΛάΛΟΛΩΓΘΞΜΞσΞΩΓΦΤβΛΫΛ≥ΛιΟφΛΥ βΛΛΛΤΛΛΛκΓΘ

Η―ΛΥΛΪΛόΛλΛΤΛΖΛόΛΠΛ»ΓΔ

Ξ®Ξ≠ΞΈΞ≥ΞΟΞ·ΞΙΛ»ΛΛΛΠ¥ώ…¬ΛρΜΐΛΟΛΤΛΛΛκΛΈΛ«ΓΔΩΫάΝΓΠΞ–ΞΆΛρΛΣΛΛΛΤΓΔ α≥ΆΛΖΛΤΛΛΛκΑΌΓΔ…‘ΥΓΛ«ΛœΛ ΛΛΓΘ

Λ¥ά≈ΡΑΛΔΛξΛ§Λ»ΛΠΛ¥ΛΕΛΛΛόΛΖΛΩ

Γζ Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛ ΩΆΛΈΆΦΛΌ Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛΣΛδΛΗΛΈΛΡΛ÷ΛδΛ≠Γ÷Λ≥ΛσΛ Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛœΥ®Λ®ΛκΓΉ

:

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛ ΩΆΛΈΆΦΛΌ Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛΣΛδΛΗΛΈΛΡΛ÷ΛδΛ≠Γ÷Λ≥ΛσΛ Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛœΥ®Λ®ΛκΓΉ

Χν¬ΦΝμΙγΗΠΒφΫξ ΞΖΞΙΞΤΞύΞόΞΆΞΗΞαΞσΞ»ΜωΕ»Υή…τ Νΐ± Μα

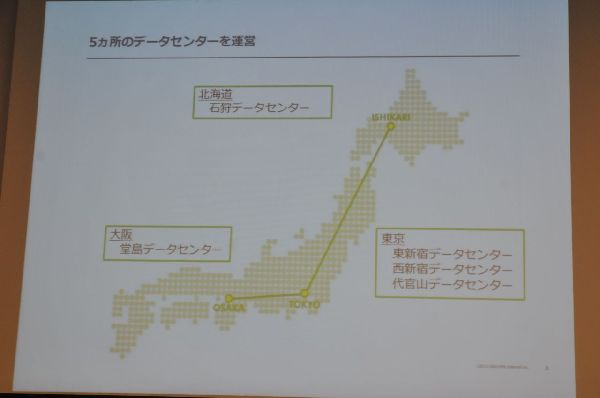

ΛΩΛ·ΛΒΛσΛΈDCΛρΗΪΛΤΛΛΛκΓΘ

ΦΧΩΩΛρΛ»ΛΟΛΝΛψΛΛΛ±Λ ΛΛΛΈΛ«ΓΔΆΨΛξΒ≠œΩΛ§Λ ΛΛΛΈΛ«ΓΔΈρΜΥΛράβΧάΛΖΛΤΛΏΛόΛΙΓΘ

ΞύΓΦΞΔΛΈΥΓ¬ßΛΟΛΤΛ¥¬ΗΛΗΛ«ΛΙΛΪΓ©

Λ≥ΛλΛ§ΛΚΛΟΛ»ΧΛΛάΛΥ¬≥ΛΛΛΤΛΛΛόΛΙΓΘ

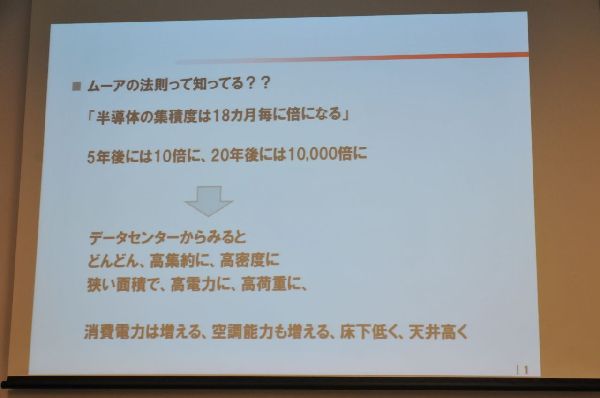

1970«·ΚΔΛΥΓΔIntelΦ“ΛΈΝœάΏΦ‘ΛΈΑλΩΆΛ«ΛΔΛκ Gordon Moore ΛΒΛσΛ§ΛΣΛΟΛΖΛψΛΟΛΩΗάΆ’Λ§ΛΚΛΟΛ»¬≥ΛΛΛΤΛΛΛόΛΙΓΘ

»ΨΤ≥¬ΈΛΈΫΗά―≈ΌΛœ18ΞωΖνΛ««ήΛΥΛ ΛκΓΔ3«·≤σΛ«4«ήΛΥΓΔ5«·ΗεΛΥΛœ10«ήΓΔ20«·ΗεΛΥΛœ10000«ήΛ»Λ ΛΟΛΤΛΛΛόΛΙΓΘ

»ΨΤ≥¬ΈΛάΛ±Λ«ΛβΛ Λ·ΓΔΞ«ΞΘΞΙΞ·ΛβΓΔΛβΛΠΛάΛαΛάΛαΛ»ΛΛΛΛΛ Λ§ΛιΓΔΙβΫΗΧσΛΥΛ ΛΟΛΤΛΛΛόΛΙΓΘ

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦ≤ΑΛΒΛσΛΪΛιΛΏΛκΛ»ΓΔΙβΫΗΧσΓΔΙβΧ©≈ΌΛ»Λ ΛξΓΔΕΙΛΛΨλΫξΛΥΓΔΜ≥ΛΈΛηΛΠΛΥά―ΛόΛλΛΤΙβ≈≈ΈœΓΔΙβ≤ΟΫ≈Λ«ΓΔ»σΨοΛΥ≈≈ΈœΛ§ΝΐΛ®ΛκΓΔΕθΡ¥«ΫΈœΛβΝΐΛ®ΛκΓΔΨ≤≤ΦΛβΡψΛ·ΓΔ≈ΖΑφΙβΛ·Λ»ΛΛΛΠΛ≥ΛΠΛΛΛΠΈ°ΛλΛ§Λ≥Λ≥ΛΈΛ»Λ≥Λμ2, 30«·¬≥ΛΛΛΤΛΛΛόΛΙΓΘ

1973«·ΫΉΙ© Ξ≥ΞσΞ‘ΞεΓΦΞΩΞ”Ξκ

1973«·ΫΉΙ©ΓΔΧν¬ΦΝμΙγΗΠΒφΫξΛ§ΚνΛΟΛΩΞ≥ΞσΞ‘ΞεΓΦΞΩΞ”ΞκΓΘ

ΦΧΩΩΛ«ΛœΛ Λ·ΛΤΓΔ≥®ΛΥΛ ΛΟΛΤΛΛΛκΓΘ

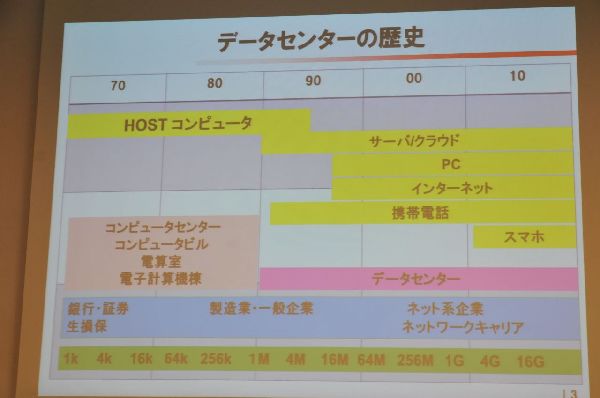

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛ»ΛΛΛΠ≤ΩΛβΧΒΛΛΚΔΛΥΓΔΛ…ΛΠΛδΛΟΛΤDCΛρΚνΛλΛ–ΛΛΛΛΛΈΓ©Λ»ΛΛΛΠΛ≥Λ»Λ«ΓΔΤϋΥήΛ«ΫιΛαΛΤΛΥΕαΛΛΓΔΞ”ΞκΛρΛΡΛ·ΛΟΛΩΓΘ70«·¬εΓΝ90«·¬ε»ΨΛ–ΛόΛ«ΛœΓΔΞέΞΙΞ»Ξ≥ΞσΞ‘ΞεΓΦΞΩΛ§ΦγΈ°ΓΘ

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛΈΈρΜΥ

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛ»ΛΛΛΠ≤ΩΛβΧΒΛΛΚΔΛΥΓΔΛ…ΛΠΛδΛΟΛΤΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛρΚνΛλΛ–ΛΛΛΛΛΈΓ©Λ»ΛΛΛΠΛ≥Λ»Λ«ΓΔΤϋΥήΛ«ΫιΛαΛΤΛΥΕαΛΛΓΔΞ”ΞκΛρΛΡΛ·ΛΟΛΩΓΘ70«·¬εΓΝ90«·¬ε»ΨΛ–ΛόΛ«ΛœΓΔΞέΞΙΞ»Ξ≥ΞσΞ‘ΞεΓΦΞΩΛ§ΦγΈ°ΓΘΛΫΛ≥ΛΪΛιΓΔΞΒΓΦΞ–ΓΔΞ·ΞιΞΠΞ…ΓΔPCΓΘ

≥ßΛΒΛσΛβΛΟΛ»ΦψΛΛΛ»ΛΣΛβΛΟΛΤΛΛΛΩΛΈΛ«ΓΔ≥ßΛΒΛσΟΈΛιΛ ΛΛΛ»ΜΉΛΟΛΤΛΛΛΩΛ§ΓΔInteropΛ«PCΑλΩΆ1¬φΛΥΛ…ΛΠΖόΛ®ΛκΛΪΓΔΛ»96«·ΛΥΙ÷±ιΛΖΛΩΓΘ≤ώΦ“ΛΥ…τΛΥ1¬φΓΔ≤ίΛΥ1¬φΛ»ΛΛΛΠΚΔΓΘΛόΛάΓΔΞΛΞσΞΩΓΦΞΆΞΟΞ»ΛœΛœΛδΛΟΛΤΛΛΛ ΛΪΛΟΛΩΚΔΓΘ

Ζ»¬”≈≈œΟΛ§ΛΔΛΟΛΩΛ±Λ…ΓΔΛΩΛάΛΈ≈≈œΟΛ»ΛΛΛΠΜΰ¬εΓΘάΈΛœΓΔΞ≥ΞσΞ‘ΞεΓΦΞΩΞ”ΞκΓΔΞ≥ΞσΞ‘ΞεΓΦΞΩΞΜΞσΞΩΓΦΓΔ≈≈ΜΜΒΓ≈οΓΔ≈≈Μ“ΖΉΜΜΒΓ≈οΓΔΛ Λ…Λ»ΛΛΛοΛλΛΤΛΛΛΩΛ§ΓΔΞΛΞσΞΩΓΦΞΆΞΟΞ»Λ§ΛœΛδΛξΜœΛαΛΤΓΔΞΔΞαΞξΞΪΛΪΛιiDCΛ»ΛΛΛΠΗάΆ’Λ§ΛœΛΛΛΟΛΤΛ≠ΛΤΓΔ90«·¬εΫιΛαΚΔΛΪΛιΓΔΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛ»ΗάΛΠΛηΛΠΛΥΛ ΛΟΛΩΛ»ΜΉΛΠΓΘ

Λ≥ΛΈΚΔΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛρΚνΛΟΛΩΛΈΛœΓΔΕδΙ‘ΓΔΨΎΖτΓΔάΗ¬Μ ίΛ»ΛΪΓΘΞ–Ξ÷ΞξΓΦΛ ΚΔΛΥΓΔάΫ¬ΛΕ»ΓΔΑλ»Χ¥κΕ»Λ§Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛρΚνΛΟΛΩΓΘΚΘΛœΞΆΞΟΞ»Ζœ¥κΕ»ΓΔΞΆΞΟΞ»ΞοΓΦΞ·Ξ≠ΞψΞξΞΔΓΔΛΒΛ·ΛιΛΒΛσΛΈΆΆΛ άλΧγΕ»Φ‘Λ§ΚνΛκΛηΛΠΛΥΛ ΛΟΛΩΓΘ

≤ΦΛΈΈ–ΛœΓΔΞύΓΦΞΔΛΈΥΓ¬ßΛ«ΓΔΞαΞβΞξΛΈΆΤΈΧΛΥΛΡΛΛΛΤΫώΛΛΛΩΓΘ

ΤϋΈ©ΛΈΞέΞΙΞ»Ξ≥ΞσΞ‘ΞεΓΦΞΩΛ§ΤΰΛΟΛΩΚΔΓΔΞαΞΛΞσΞαΞβΞξΛ§64kbΛΔΛκΛΨΛ»ΛΛΛΟΛΤΛΛΛκΛ§ΓΔΚΘΛ»Λ ΛΟΛΤΛœΓΔ64KΛ«ΛœΨ·Λ ΛΛΓΘΚΘΛ«ΛœΓΔ1ΞΝΞΟΞΉΛ«4GΛβΛΔΛκΨθΕΖΓΘ

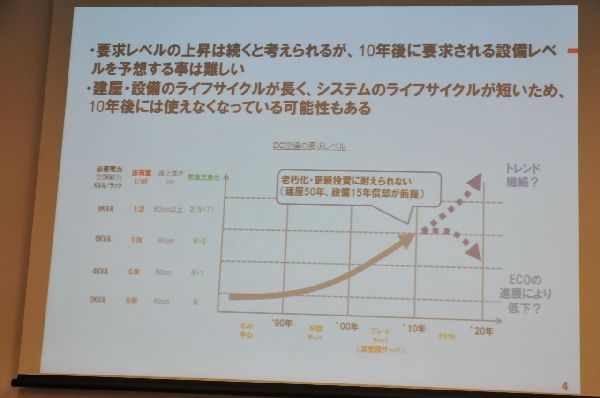

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛΥΆΉΒαΛΒΛλΛκΞλΞΌΞκΛ«ΛœΓΔΖζ ΣΛρ≤ΰ¬ΛΛΖΛΩΛξΛΖΛΩΛι≤ΩΛ»ΛΪΛβΛΝΛ≥ΛΩΛ®ΛλΛκΛ»ΛΛΛΠΨθΕΖΛΪΛιΓΔΑλ»ΧΞ”ΞκΛ«Λœ¬―Λ®ΛλΛ Λ·Λ ΛΟΛΤΛ≠ΛΤΛΛΛκΛΈΛ§ΚΘΛΈΗΫΨθΓΘ

ΕθΡ¥«ΫΈœΓΔ≤ΟΫ≈ΓΔΝς…ςΛΈΑΌΛΈΨ≤≤ΦΛΈΙβΛΒΛ Λ…ΓΔ≈≈ΗΜΛΈΨιΡΙ≤ΫΛ Λ…ΓΔΆΉΒαΛ§ΨεΛ§ΛΟΛΤΛ≠ΛΤΛΛΛκΛΈΛ«ΓΔάλΆ―ΛΈΖζ ΣΛρ¬ΛΛιΛ ΛΛΛ»ΓΔΧΒΆΐΛΥΛ ΛΟΛΤΛ≠ΛΩΓΘœΖΒύ≤ΫΛ»ΛΪΛΥ¬―Λ®ΛλΛ Λ·Λ ΛΟΛΤΛ≠ΛΩΛΈΛ§ΗΫΨθΛ«ΛΙΓΘ

1990«·¬φΝΑ»ΨΛΥΛΡΛ·ΛΟΛΩΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛœ20«·ΖζΛΟΛΤΛΛΛΤΓΔ≤ΰ¬ΛΛΙΛλΛ–ΓΔΛόΛΩΜ»Λ®ΛκΛΪΛ»ΛΛΛΠΛ»ΓΔΛΫΛΠΛΛΛΠΨθΕΖΛ«ΛœΛ ΛΛΓΘΛΫΛλΛ§ΚΘΛΈΧδ¬ξΓΘΖζ ΣΛœ50«·Λ«ΫΰΒ―¥ϋ¥÷ΓΔάΏ»ςΛœ15ΓΝ20«·Λ«≤ΰΫΛΛΖΛΤΛΛΛΪΛ ΛΛΛ»ΛΛΛ±Λ ΛΛΓΘΞ≥ΞσΞ‘ΞεΓΦΞΩΛœ5«·ΥηΛΈΞΒΞΛΞ·ΞκΛΥΛ ΛΟΛΤΛΣΛξΓΔΛΙΛΑΛΥΛΫΛ≥Λ§ΞΔΞσΞόΞΟΞΝΛΥΛ ΛΟΛΤΛΖΛόΛΠΓΘ

άΈΛΈΞέΞΙΞ»Ξ≥ΞσΞ‘ΞεΓΦΞΩΜΰ¬εΛΥΛβΛΔΛΟΛΤΓΔΛΏΛσΛ ΩεΈδΛΥΛ ΛΟΛΤΓΔΩεΛΈ«έ¥…Ι©ΛΥΛ ΛΟΛΝΛψΛΠΛηΛ»ΛΔΛΟΛΩΛ§ΓΔCMOSΛΥΛ ΛΟΛΤΓΔ90«·»ΨΛ–ΛΥΨΟ»ώ≈≈ΈœΛ§ΛΑΛΟΛ»≤ΦΛ§ΛΟΛΤΛΛΛκΓΘ

Υή≈ωΛΥ≈≈ΒΛΛ§ΛΛΛΟΛ―ΛΛΕτΛΠΨθΕΖΛ«¬≥Λ·ΨθΕΖΛ ΛΈΛΪΓΔ≤ΦΛ§ΛκΨθΕΖΛ ΛΈΛΪΓΔΛ≥ΛΈ ’Λ§»σΨοΛΥ §ΛΪΛιΛΚΓΔ«ΚΛσΛ«ΛΛΛκΓΘ

ΚΘΛΈΛ»Λ≥ΛμΛœΛ“ΛΩΛΙΛι≈≈ΈœΛ§ΨεΛ§ΛΟΛΤΛΛΛ·Λ»ΙΆΛ®ΛΤΛΛΛκΓΘ

≥ßΛΒΛσΛ§Λ¥¬ΗΛΗΛΈΒΰΛρΛΛΛλΛκΛΩΛαΛΥΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛράλΆ―ΛΥΚνΛΟΛΩΩάΗΆΛΈΞ»ΓΦλΑΞΔΓΘ

Κ«≈§≤ΫΛΙΛκΛΩΛαΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΓΘ

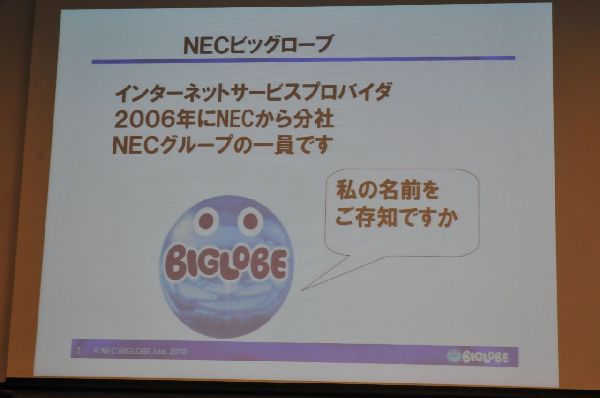

IDCΞ’ΞμΞσΞΤΞΘΞΔΛΒΛσΛ»ΛΪΛΛΛμΛΛΛμΖ–ΑόΛρ ßΛοΛ ΛΛΛ»ΛΛΛ±Λ ΛΛΛΈΛΪΛ Λ»ΜΉΛΠΛΈΛœΓΔΞΔΞΗΞΔΞσΞ’ΞμΞσΞΤΞΘΞΔΛΒΛσΓΘΛΝΛγΛΟΛ»ΦΧΩΩΛ§Έ…Λ·Λ ΛΛΛ§ΓΔΛ≥ΛλΛΑΛιΛΛΛΖΛΪΞΆΞΟΞ»ΛΥΛ ΛΪΛΟΛΩΛΈΛ«ΛΙΛ§ΓΘά–ΦμΛΒΛσΛβΓΘ

10 §Λ«ΛδΛλΛ»ΛΛΛοΛλΛΩΝαΛΙΛ°Λκ(Ψ–ΓΥ

Μ ≤ώ: Μΰ¥÷¬γΨφ…ΉΛ«ΛΙΓΘ

¬ΩΥύΛΥΚΘΓΔΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛρΚνΛΟΛΤΛΛΛκΓΘ

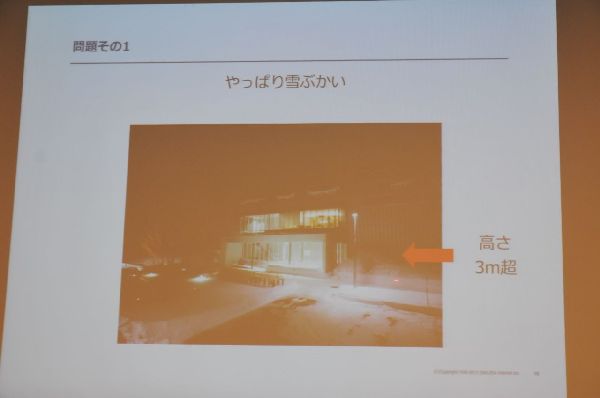

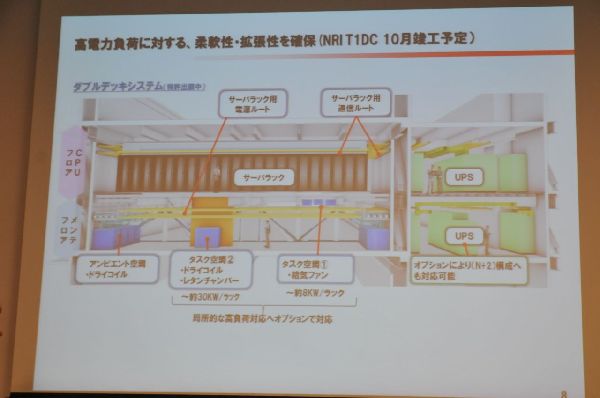

Ιβ…ι≤ΌΛ«ΛβΛΛΛ±ΛκΛηΛΠΛΥΛδΛΟΛΝΛψΛ®Λ»ΗάΛΠΛ≥Λ»Λ«ΓΔΞάΞ÷ΞκΞ«ΞΟΞ≠ΞΖΞΙΞΤΞύΓΘ

ΚΘΛόΛ«60cmΛ»ΛΪ80cmΛ»ΛΪΛάΛΟΛΩΛΈΛρΓΔΨ≤≤Φ3mΛΥΛΖΛΩΓΘ

¬γΛ≠Λ·ΛœΒΛΈ°ΛœΝ¥¬ΈΛ«≤σΛΟΛΤΛΛΛκΛ§ΓΔΙβ…ι≤ΌΛ ΛΈΛ§ΝΐΛ®ΛΩΛιΓΔΞΩΞΙΞ·ΕθΡ¥ΛρΛΣΛΛΛΤΓΔΞιΞΟΞ·Ο±ΑΧΛρΈδΛδΛΜΛκΛηΛΠΛΥάΏΖΉΛΖΛΩΓΘΥή≈ωΛΥΛ≥ΛΠΛΛΛΠΛΈΛ§Λ≠ΛΩΛιΛ…ΛΠΛΖΛηΛΠΓ©Λ»ΛΏΛσΛ Λ«Ι‘ΛΟΛΤΛΛΛκΓΘΛ≥ΛΠΛΛΛΠΛΈΛρΚνΛΟΛΤΛΖΛόΛΟΛΩΓΘ

ΚνΛξΨεΛœΓΔΚΘ≈ΌΛΈΞ―ΞΆΞκΞ«ΞΘΞΙΞΪΞΟΞΖΞγΞσΛΈΜώΈΝΛάΛ±Λ…ΓΔΫ–ΛΖΛΤΛΖΛόΛΟΛΩΓΘ

ΦΪΥΐΛΖΛΤΛΣΛ·ΓΘ

ΚνΛξΨεΛœ1≥§ΖζΛΤΓΘΩΩΛσΟφΛΥΓΔ≈≈ΒΛΛΏΛΩΛΛΛ ΕβΧ÷ΛρΛΣΛΛΛΤΓΔΛΫΛΈΨεΛΥΞΒΓΦΞ–Λ§ΚήΛΟΛΤΛΛΛκΛ»ΛΛΛΠΙΫ¬ΛΓΘ

Λ≥ΛλΛ«ΓΔΖκΙΫΈδΒΛΛ§ΛΩΛόΛΟΛΤΛΛΛκΛΈΛ«ΆΨΛξ…ςΑΒΛρΛΪΛ±Λ Λ·ΛΤΛβΓΔΕθΡ¥ΗζΈ®Λ§ΛηΛΛΓΘ1/1ΧœΖΩΛρΛΡΛ·ΛΟΛΤΦ¬Η≥ΛρΛΖΛΩΓΘΗζΈ®Έ…Λ·ΈδΛδΛΜΛκΞ®Ξ≥Λ Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛρΚνΛΟΛΩΓΘ10ΖνΛΥΫΉΙ©Λ ΛΈΛ«ΓΔΞ®Ξ≥ΛΥΫ–ΆηΛκΛœΛΚΛ«ΛΙΓΘ

ΛΩΛάΓΔΛΔΛσΛόΛξΙΆΛ®ΛιΛλΛΤΛΛΛ Λ·ΛΤΓΔΨεΛ«ΞΆΞΗΛρΛΖΛαΛΤΓΔΛίΛμΛΟΛ»ΆνΛ»ΛΙΛ»ΓΔ4m≤ΦΛόΛ«ΆνΛΝΛΝΛψΛΠΛΈΛ«ΓΔΞαΞΟΞΖΞεΛΥΛ ΛΟΛΤΛΛΛκΛΈΛ«ΓΔΞΙΞΪΓΦΞ»ΛρΟεΛκSEΛΈΫςΛΈΜ“Λ§ΛœΛΛΛλΛ ΛΛΛδΛσΛ»ΛΪΓΔΦ“ΤβΛ«ΗάΛοΛλΛΤΛΛΛκΓΘ

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΕ®≤ώΛ«≥Λ≥ΑΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΗΪ≥ΊΛρΗφΚΓ ΐΛΈΛ«ΓΔ¥ Ο±ΛΥΨ“≤πΓΘ

ΞΖΞσΞ§ΞίΓΦΞκΓΘ≈λΒΰ≈‘23ΕηΛΑΛιΛΛΛΈΙώΛ«ΓΔΨΠΕ»≈ΣΛ Βρ≈άΓΔΕβΆΜ≈ΣΛ Βρ≈άΓΔΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛ Λ…Λ§ΛΩΛ·ΛΒΛσΆ≠ΛξΓΔΛΫΛΈΟφΛ«4ΛΡΛέΛ…Ψ“≤πΛΖΛόΛΙΓΘ

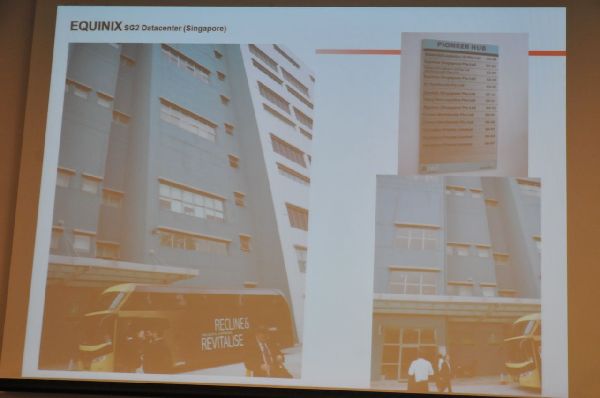

EQUINIX SG2 DetaCenter

ΤϋΥήΛΥ…ιΛ±Λ ΛΛΛΑΛιΛΛΛΈΈ©«…Λ EquinixΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΓΘ

≥Α¥―ΛάΛ±Λ ΛΈΛ«ΆΨΛξΛΣΛβΛΖΛμΛ·Λ ΛΛΓΘ

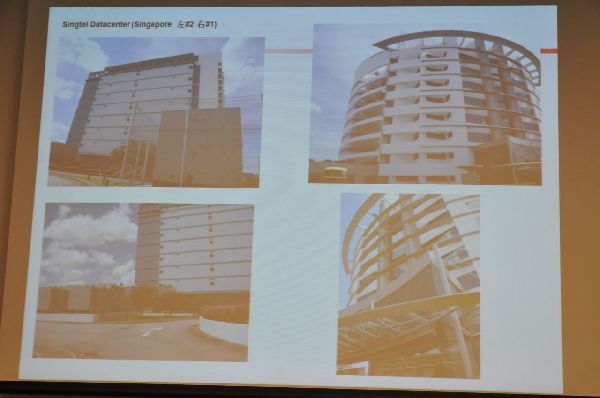

Singtel DetaCenter

SingtelΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΓΘ

ΜΆ≥―ΛΛΛΈΛ»¥ίΛΛΛΈΛ§ ¬ΛσΛ«ΛΛΛΤΓΔΜΆ≥―ΛΛΛέΛΠΛ§ΩΖΛΖΛΛΓΘ

ΧΎΛρΛΆΛιΛΟΛΤ¥ίΛΛΛΈΛρΛΡΛ·ΛΟΛΤΛΏΛΩΛ§ΓΔΜ»ΛΛΨΓΦξΛ§Έ…Λ·Λ ΛΪΛΟΛΩΓΘ

Tata Communications

TataΛœΞΛΞσΞ…ΛΈ≤ώΦ“ΛάΛ§ΓΔά«ΕβΛ§Α¬ΛΛΞΖΞσΞ§ΞίΓΦΞκΛΥΥήΦ“ΛρΑήΛΖΛΩΓΘ

ΙΛΛΛΤΛΏΛΩΛ»Λ≥ΛμΓΔάΛ≥ΠΛΈΘΖΓΝΘΗ≥δΛΈΗςΞ’ΞΓΞΛΞ–ΛρΫξΆ≠ΛΖΛΤΛΛΛκΛιΛΖΛΛΓΘ

ΟΈΛιΛΧ¥÷ΛΥΞΛΞσΞ…ΛΥΩΜΩ©ΛΒΛλΛΤΛΛΛΩΓΘ

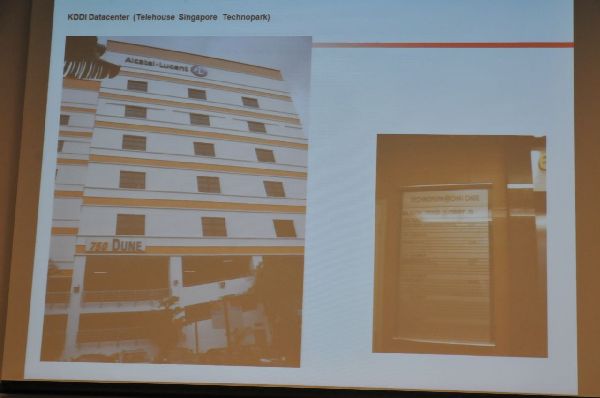

KDDI DetaCenter(AlcatelLucent)

ΞΔΞκΞΪΞΤΞκΞκΓΦΞΜΞσΞ»ΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛάΛ§ΓΔ3, 4F(ΥΚΛλΛόΛΖΛΩΛ§ΓΔΓΔ)ΛΈ2Ξ’ΞμΞΔΛ§KDDIΛΈΞ”ΞκΛ»Λ ΛΟΛΤΛΛΛκΓΘ

ΞΜΞσΞΩΓΦΛΈ¬ΠΧΧΛ–ΛΪΛξΛ«ΩΫΛΖΧθΛ ΛΛΛ§ΓΔάΏ»ς≈ΣΛΥΛœΤϋΥήΛ» ―ΛοΛιΛ ΛΛΓΘ

Τ±ΛΗΛηΛΠΛ Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛρΛβΛΟΛΤΛιΛΟΛΖΛψΛκΓΘΛ»ΛΛΛΠΛΈΛ§ΞΖΞσΞ§ΞίΓΦΞκΛΈΨθΕΖΓΘ

ΤϋΥήΛηΛξΓΔΑλΩΆΛΔΛΩΛξΛΈGNPΛ§¬γΛ≠ΛΛΛΑΛιΛΛΛάΛΪΛιΓΔ¬γάηΩ ΙώΛ«ΛΪΛ ΛξΩ ΛσΛ«ΛΛΛκΓΘ

ΞέΓΦΞΏΞΝΞσΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦ

μλΠΞύΛœΞΖΞγΞΟΞ≠ΞσΞΑΛ«ΛΏΛσΛ ΛΣΛβΛΖΛμΛΛΛ»ΛΣΛβΛΠΓΘ

μλΠΞύΛΈΟφΛΥΛΔΛκ≥ΙΛΈΟφΛΥΛΔΛκ…αΡΧΛΈ≈≈ΟλΓΘ

≈≈ΟλΛΥ≈≈œΟάΰΛ»ΛΛΛΠΛΪΓΔΡΧΩ°≤σάΰΛ§ΛΑΛΝΛψΛΑΛΝΛψΛΑΛΝΛψΛ»ΡΞΛξΫδΛιΛΒΛλΛΤΛΛΛκΓΘ

»τΛ”ΨεΛ§ΛκΛ» αΛόΛ®ΛλΛκΛΈΛ«ΛœΛ ΛΛΛΪΛ»ΛΛΛΠΛΑΛιΛΛΓΔΩβΛλ≤ΦΛ§ΛΟΛΤΛΛΛκΓΘ

ΛΫΛΈΛόΛόΓΔDCΛΪΛι≈≈ΟλΖ–Ά≥Λ«≈≈άΰΛ§ΛΛΛΟΛΤΛΛΛκΛΙΛ–ΛιΛΖΛΛΨθΕΖΛ«ΛΔΛκΓΘ

ΛΛΛ·ΛΡΛΪΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛ§ΛΔΛΟΛΩΛ§ΓΔΞΣΞ’ΞΘΞΙΞ”ΞκΛρ≤ΰ¬ΛΛΖΛόΛΖΛΩΓΘΛ»ΛΛΛΠ¥ΕΛΗΛ«ΓΔ≈≈ΟλΛΈΝΑΛΪΛιΓΔΛ≥Λ≥ΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛΥ≈≈άΰΛ§ΛΑΛΟΛ»ΛΛΛΟΛΤΛκΓΘ¬γΨφ…ΉΛ ΛΈΛΪΓ©Λ» ΙΛΛΛΩΛ»Λ≥ΛμΓΔΗςΞ±ΓΦΞ÷ΞκΛœΟœ≤ΦΛΪΛιΛ≠ΛΤΛΛΛκΛΈΛ«ΓΔ¬γΨφ…ΉΛ»ΛΛΛΟΛΤΛΛΛκΓΘΙ‘ΛΟΛΩΩΆ¥÷ΛœΛΏΛσΛ ΓΔΛέΛσΛ»ΛΪΓΝΓ©Λ»ΜΉΛΟΛΤΛΛΛΩΓΘ

FPT DetaCenter (Cietnam)

μλΠΞύΛΈΖ≥¥ΊΖΗΛ§ΜΐΛΟΛΤΛΛΛκΞ≠ΞψΞξΞΔΛΈΜ“≤ώΦ“Λ§ΛδΛΟΛΤΛΛΛκΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛ«ΓΔ»σΨοΛΥΖΌ≤ϋΗΖΫ≈Λ«ΓΔ≥δΛ»ΤϋΥήΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛΥΕαΛΛΛΈΛρΜΐΛΟΛΤΛΛΛκΓΘ

Ξ≠ΞψΞξΞΔΛ ΛΈΛ«ΓΔΞέΓΦΞΝΞΏΞσΓΝΞœΞΈΞΛΛ»ΛΈ¥÷Λβ¬άΛΛ≤σάΰΛ§ΛΔΛΟΛΤΓΔΘ≤Βρ≈άΛ«ΛδΛΟΛΤΛΛΛκΛηΛ»ΛΛΛΠΞ«ΓΦΞΩΞΜΞσΞΩΓΦ

ΙώΤβΛΈΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛρΨ“≤πΛΙΛκΛ»ΓΔΗλ άΛ§ΛΔΛκΛΈΛ«ΓΔ≥Λ≥ΑΛΈΛρ¥ Ο±ΛΥΨ“≤πΛΖΛΤΛΏΛόΛΖΛΩΓΘ

Α ΨεΛ«ΓΔΜδΛΈ»·…ΫΛœΫΣΛοΛιΛΒΛΜΛΤΛΛΛΩΛάΛ≠ΛόΛΙΓΘ

Γζ ΗςΞ±ΓΦΞ÷ΞκΛΈ±ΡΕ»Λ§ΛδΛΟΛΤΛ≠ΛΩΓΣ±ΩΆ―¬ΠΛœΛ≥ΛΠΛΡΛΟΛ≥ΛαΓΣ:

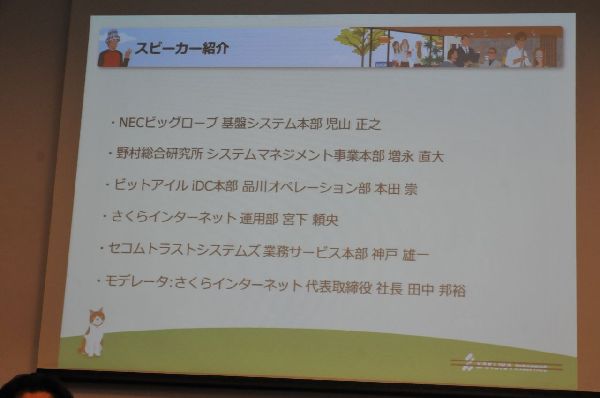

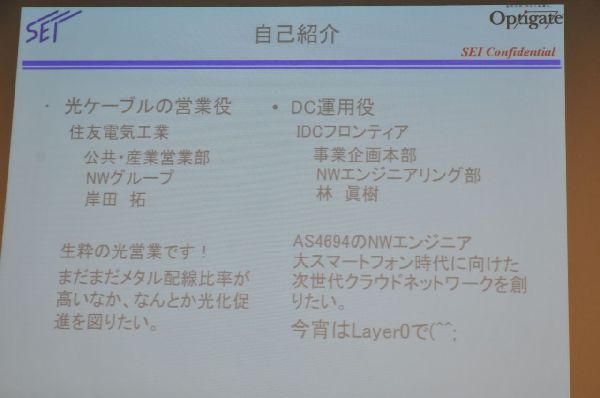

IDCΞ’ΞμΞσΞΤΞΘΞΔ ΜωΕ»¥κ≤ηΥή…τ Έ”Μα

ΫΜΆß≈≈Ι© ΗχΕΠΓΠΜΚΕ»±ΡΕ»…τ ΞΆΞΟΞ»ΞοΓΦΞ·ΞΑΞκΓΦΞΉ ¥Ώ≈ΡΜα

ΜωΧ≥Ε…¬ΠΛΪΛιΧΒΟψΛ ΆΉΒαΛ«ΓΔΗςΛΥ¥ΊΛΖΛΤΓΔΛΣΛβΛΖΛμΛΣΛΪΛΖΛ·ΓΔΛΪΛΡΛόΛΗΛαΛΥΗςΛρΨ“≤πΛΖΛΤΛ·ΛλΛ»ΛΛΛΠΛ≥Λ»Λ«ΓΔ10 §ΛέΛ…ΛΣΜΰ¥÷ΛρΡΚΛΛΛΤάβΧάΛΒΛΜΛΤΛΛΛΩΛάΛ≠ΛόΛΙΓΘ

ΜΑ…τΙΫά°ΛιΛΖΛΛΓΠΓΠΓΠ

ΚΘΤϋΛœΗςΛ«3…τΙΫά°Λ«ΛΣœΟΛΒΛΜΛΤΛΛΛΩΛάΛ≠ΛόΛΙΓΘ

ΫΜΆß≈≈Ι©ΛΈΛ¥ΡσΑΤ

1≈άΧήΓΘ

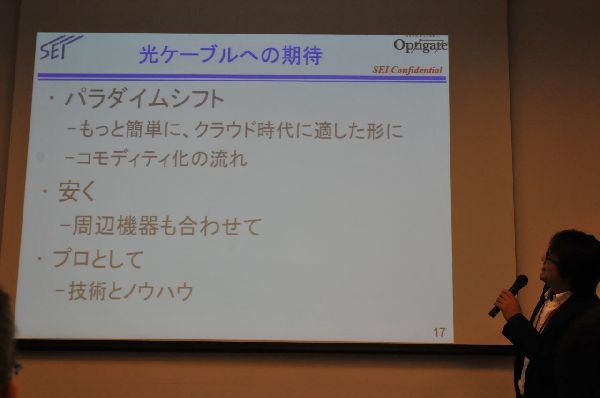

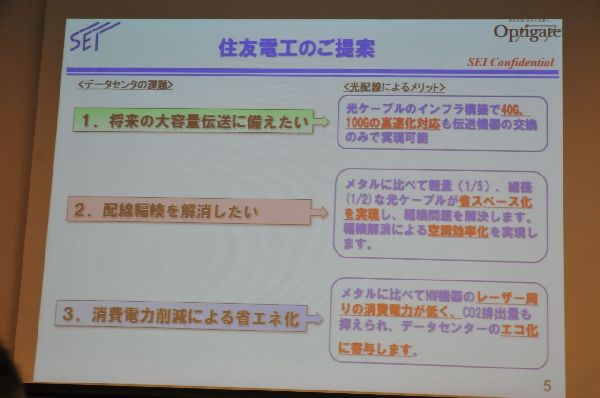

Ξ«ΓΦΞΩΞΜΞσΞΩΓΦΛ«ΛΈ≤ί¬ξΓΔΆΉΥΨΓΘ

Ψ≠ΆηΛΈ¬γΆΤΈΧ≈ΝΝςΛΥ»ςΛ®ΛΩΛΛΓΘ

Λ≥ΛΝΛιΛΥ¥ΊΛΖΛΤΛœΓΔΗςΛΥ¥ΊΛΖΛΤΓΔΞΛΞσΞ’ΞιΙΫΟέΛρΗςΛ«ΛδΛκΓΘ

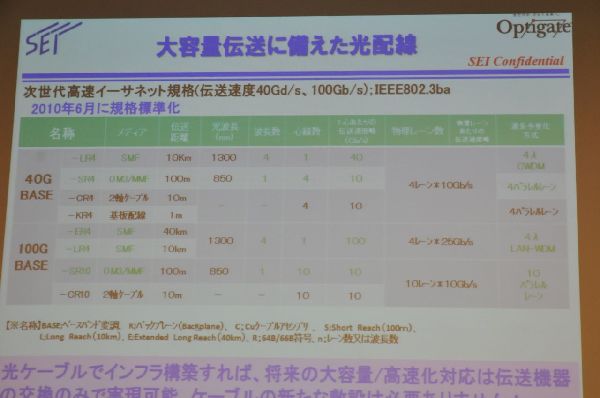

40GΓΔ100GΛ»ΛΛΛΠΙβ¬°≤Ϋ¬–±ΰΓΘΛ≥ΛΠΛΛΛΟΛΩ≈ΝΝςΒΓ¥οΛΈΗρ¥ΙΛΈΛΏΛ«Ι‘ΛΛΛΩΛΛΓΘ

2≈άΧήΓΘ

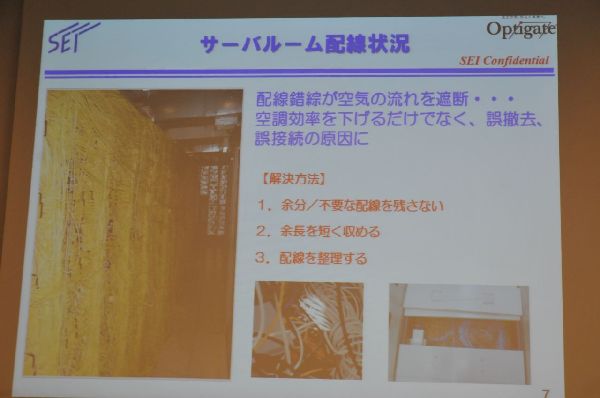

«έάΰΛΈμ’μ‘Λρ≤ρΨΟΛΖΛΩΛΛΓΘ

«έάΰΛΈΞαΞΩΞκΛΥ»φΛΌΛΤΓΔΗςΛœ»σΨοΛΥΖΎΈΧΛΪΛΡΚ«ΖΎΛ»ΛΛΛΟΛΩΛ»Λ≥ΛμΛ«Ψ ΞΙΞΎΓΦΞΙ≤ΫΛ Λ…ΓΘΕθΡ¥ΛΈΗζΈ®ΛρΦ¬ΗΫΫ–ΆηΛΩΛξΛΙΛκΛΈΛ«ΛœΛ ΛΛΛΪΓΘ

3≈άΧήΓΘ

ΨΟ»ώ≈≈ΈœΚοΗΚΛΥΛηΛκΨ Ξ®ΞΆ≤ΫΓΘ

ΞΆΞΟΞ»ΞοΓΦΞ·ΒΓ¥οΛ§ΞαΞΩΞκΛΥ»φΛΌΛΤΞλΓΦΞΕΓΦΦΰΛξΛΈΨΟ»ώ≈≈ΈœΛ§ΡψΛ·ΓΔCO2ΛΈ«”Ϋ–ΈΧΛβΆόΛ®ΛιΛλΞ«ΓΦΞΩΞΜΞσΞΩΓΦΛΈΞ®Ξ≥≤ΫΛ§Ϋ–ΆηΛκΓΘ

¬γΆΤΈΧ≈ΝΝςΛΥ»ςΛ®ΛΩΗς«έάΰ

40GΓΔ100GΛΈΒ§≥ Λ§…ΗΫύ≤ΫΛΒΛλΛΩΓΘ

≈ΝΝςΒςΈΞΛΈά©Η¬Λ Λ…ΛΈά©Η¬Λ§ΛΔΛκΓΘ

Κ«ΫιΛΪΛιΗςΛράß»σ…ΏάΏΛΖΛΤΛΛΛΩΛάΛ±ΛλΛ–ΓΔ¬γΆΤΈΧΛ«ΛβΗεΓΙ¬–±ΰΫ–ΆηΛκΓΘ

ΞΒΓΦΞ–ΞκΓΦΞύ«έάΰΨθΕΖ

ΗΪΜωΛ ΞΙΞ―Ξ≤ΞΤΞΘΓΦΨθ¬÷Λ ΞΒΓΦΞ–ΞκΓΦΞύΓΘ

ΛΝΛγΛΟΛ»ΛδΛξ≤αΛ°Λ Λ»Λ≥ΛμΛ§ΛΔΛκΛΪΛβΛΖΛλΛ ΛΛΛ§ΓΔΟΒΛΖΛΤΛ≥ΛιΛλΛΩΛΈΛ§ΛΙΛ¥ΛΛΓΘ

Λ≥ΛΈΨθ¬÷ΛάΛ»ΕθΒΛΗζΈ®Λ§Α≠ΛΛΓΔΕθΡ¥ΛΈΗζΈ®Λ§ΛΙΛ¥Λ·≤ΦΛ§ΛκΛΈΛ«ΛœΛ ΛΛΛΪΓΘ

Ημ«έάΰΛ»ΛΪΗμ≈±ΒνΛ»ΛΪΓΘ≤ρΖη ΐΥΓΛ»ΛΖΛΤΛœΓΔ≈ωΛΩΛξΝΑΛ Λ≥Λ»ΛρΫώΛΛΛΤΛΛΛκΓΘ

«έάΰΛράΑΆΐΛΙΛκΛ»ΛΛΛΠΛ»Λ≥ΛμΛ«Ψ«≈άΛρΛΔΛοΛΜΛΤœΟΛρΛΒΛΜΛΤΛΛΛΩΛάΛ≠ΛόΛΙΓΘ

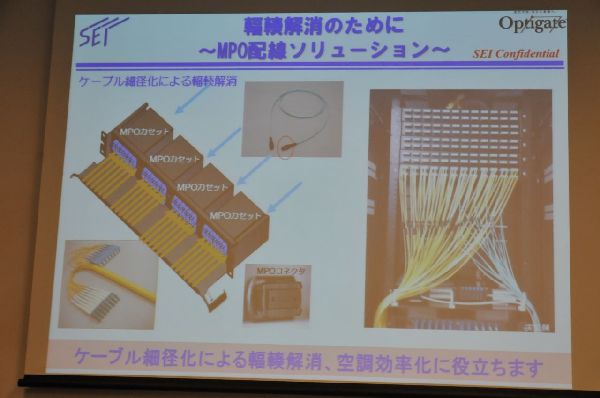

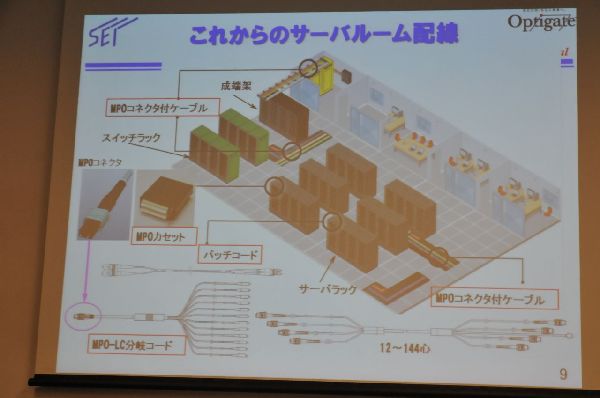

μ’μ‘≤ρΨΟΛΈΛΩΛαΛΥΓΓΓΝMPO«έάΰΞΫΞξΞεΓΦΞΖΞγΞσΓΝ

MPO«έάΰΛ»ΛΛΛΠΞΫΞξΞεΓΦΞΖΞγΞσΛρΡσΑΤΛΒΛΜΛΤΛΛΛΩΛάΛΛΛΤΛΛΛκΛΈΛ«ΛΙΛ§ΓΔΛ≥ΛΝΛιΛœ1ΦΓ¬ΠΛ§24Ω¥ΛΈΞ±ΓΦΞΙΛρΛΡΛΪΛΟΛΤΓΔ1ΦΓ¬ΠΛΈμ’μ‘Λρ≤ρΨΟΛΙΛκΓΔΞ±ΓΦΞ÷ΞκΛβΚ«ΖΎΓΔΖΉΈΧΛ»ΛΛΛΟΛΩΛ»Λ≥ΛμΓΘΛ»ΛΑΛμΨθ¬÷ΓΔΞΙΞ―Ξ≤ΞΟΞΤΞΘΓΦΨθ¬÷Λ§≤ρΨΟΛΒΛλΛκΓΘ

Λ≥ΛΠΛΛΛΠ≥®ΛΈΛηΛΠΛΥΛ ΛκΓΘ

ΥΆΛβΛΝΛγΛΟΛ»MΛ ΛΈΛ«ΓΔΗΖΛΖΛΛΛΡΛΟΛ≥ΛΏΛρΛόΛΟΛΤΛΛΛΩΛΖΛΤΛΛΛΩΛΈΛ«ΛΙΛ§(Ψ–ΓΥΛ≥Λ≥ΛœΛΝΛγΛΟΛ»ΞΙΞκΓΦΛΖΛΤΛΛΛΩΛάΛΛΛΤΓΘ

Λ≥ΛλΛΪΛιΛΈΞΒΓΦΞ–ΞκΓΦΞύ«έάΰ

Λ≥ΛλΛœΓΔάηΛέΛ…Ψ“≤πΛΖΛΩMPOΛΈΞΪΞΜΞΟΞ»ΓΘΑλ≥γ¬ΩΩΡάή¬≥ΖΩΛΈ«έάΰΛρΜ»ΛΠΛ»ΓΔΛηΛξΕθΡ¥ΗζΈ®Λ Λ…ΛΫΛΠΛΛΛΟΛΩΛ»Λ≥ΛμΛ§≤Ρ«ΫΛΥΛ ΛκΛΈΛ«ΛœΛ ΛΛΛΪΓΘ

Α¬ΛΛΛσΛ«ΛΙΛΪΓ©(Έ”)

Λ≥ΛλΛœΛ«ΛΙΛΆΓΔΑ¬ΛΛΛ«ΛΙΓΘΛ»ΛΛΛΠΛΈΛœ±≥Λ«ΛΙΓΘ

ΛδΛœΛξΓΔΞαΞΩΞκΛηΛξΙβΛΛΛ«ΛΙΓΘΛΝΛγΛΟΛ»Ξ≥ΞΙΞ»ΛΈœΟΛΥΛΡΛΛΛΤΛœΓΔΗεΛέΛ…ΒΡœάΛΒΛΜΛΤΛΛΛΩΛάΛ≠ΛόΛΙΓΘ

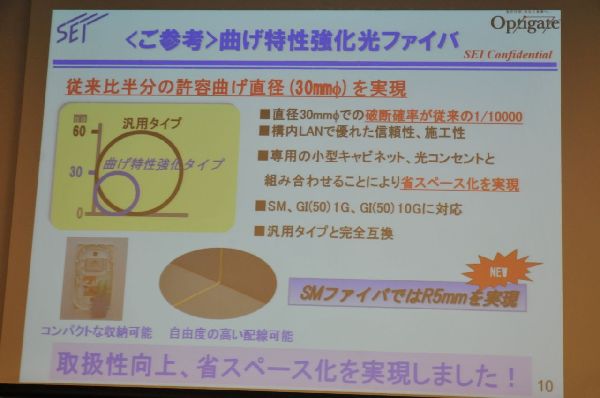

<Λ¥Μ≤ΙΆ>Ε Λ≤ΤΟά≠Ε·≤ΫΗςΞ’ΞΓΞΛΞ–

Λ≥ΛΝΛιΛ«ΛΙΛΆΓΔΛ¥Ψ“≤πΛΒΛΜΛΤΛΛΛΩΛάΛ≠ΛόΛΙΓΘΕ Λ≤ΤΟά≠Ε·≤ΫΗςΞ’ΞΓΞΛΞ–ΓΘ≥ßΛΒΛσΓΔΗςΛœΞΜΞσΞΖΞΤΞΘΞ÷ΓΔΝΓΚΌΛ ΞΛΞαΓΦΞΗΛ§ΛΔΛκΛ»ΛΣΛβΛΛΛόΛΙΛ§ΓΔΟ«άΰΛΖΛΩΛξΛ»Ζϋ«ΑΛΖΛΤΛΛΛκΛ»ΜΉΛΛΛόΛΙΛ§ΓΔΛ≥ΛΝΛιΛΥΖ«ΚήΛΖΛΤΛΛΛκΞΖΞσΞΑΞκΞβΓΦΞ…ΓΔΞόΞκΞΝΞβΓΦΞ…Λ»ΛΛΛΟΛΩR15mmΛρ…ΗΫύ≤ΫΛΒΛλΛΤΛΛΛκΓΘ

ΞΖΞσΞΑΞκΞβΓΦΞ…Λ«R5mmΛ»ΛΛΛΠΛΪΛ ΛξΕΙΛΛΞΙΞΎΓΦΞΙΛ«Ϋ–ΆηΛκΓΘ

ΡΨ≥―ΛΥΕ Λ≤ΛΤΛβ¬γΨφ…ΉΓΘ

ΛΒΛλΛκΛΪΛœ±ΩΆ―ΦΓ¬ηΛ«ΛΙΛ§....

¬―ΨΉΖβΞ±ΓΦΞ÷ΞκΓΔΙβΕ·≈ΌΖΩΞ±ΓΦΞ÷ΞκΓΘ

άηΛέΛ…ΛΈΞ’ΞΓΞΛΞ–ΛρΞ±ΓΦΞ÷Ξκ≤ΫΛΖΛΩΛβΛΈΛ«ΓΔ»σΨοΛΥ¬Ϊ«ϊΓΔΨΉΖβΛΥΕ·ΛΛΞ±ΓΦΞ÷ΞκΓΘ

Ξ’ΞξΞΔΞ·ΛρΆνΛ»ΛΖΛΤΛβ¬γΨφ…ΉΛ«ΛΙΛΪΓ©(Έ”)

ΆνΛ»ΛΖΛΤΛβ¬γΨφ…Ή

ΞιΞΟΞ·ΛΈΕ¥ΛΏΙΰΛΏΛ«Ο«άΰΛ»ΛΛΛΠΜωΗΈΛ Λ…ΛβΛΔΛκΛηΛΠΛ«ΛΙΛ§ΓΔΛ≥ΛλΛάΛ±«ϊΛΟΛΤΛβ¬γΨφ…ΉΓΘΨεΜ Λ»±ΡΕ»ΛΥΛΛΛ·Λ»Λ≠ΓΔΛ≥ΛΈΩΆΛ§ΤßΛσΛ«ΛβΟ«άΰΛΖΛόΛΜΛσΛηΛ»ΓΔ±ΡΕ»ΛΖΛΤΨεΜ ΛΥ≈ήΛιΛλΛκΓΘ

Ξ§ΞιΞΙΛΈΞœΓΦΞ»Λ§άόΛλΛΤΛκΘς(¥Ώ≈Ρ)

»σΨοΛΥΙβΕ·≈ΌΛ»ΛΛΛΠΛ≥Λ»Λ««δΛΟΛΤΛΛΛκΓΘ

ΖκΛσΛ«Λβ¬γΨφ…Ή?(Έ”ΓΥ

`